Предиктор

Предиктор в машинном обучении — это как твой личный оракул, только вместо х-цветного шара он работает с данными, а не с магическим шаром. Хочешь узнать, пойдет ли дождь, вырастут ли акции или какой сериал тебе понравится? За всем этим стоят предикторы — модели, которые превращают данные в предсказания. В этой статье мы разберем, что такое предиктор, какие они бывают, как их выбирать, и даже создадим свой на Python, чтобы предсказать цены на жилье. Погнали!

Что такое предиктор?

Предиктор — это алгоритм, который берет данные (например, температуру или твои лайки в Netflix) и выдает предсказание (дождь или "смотри это вечером"). В машинном обучении предикторы — основа: они учатся на примерах, находят закономерности и делают выводы. Скажем, предиктор может угадать, сколько домов продастся в районе, глядя на цены, площадь и школы поблизости.

Но не жди чудес: предиктор — это инструмент, а не маг. Его точность зависит от данных и модели. Плохой предиктор — как прогноз погоды от шамана с бубном, хороший — как метеостанция с ИИ. И да, чем круче данные, тем точнее он работает.

Типы предикторов: от простых до гениальных

Предикторы бывают разные, как пицца в меню — для каждого вкуса свой:

- Линейные предикторы: Линейная регрессия — классика. Предполагает, что все просто, как "больше рекламы = больше продаж". Быстро, но тупит на сложных данных.

- Нелинейные предикторы: Деревья решений, случайные леса, нейронные сети. Ловят хитрые паттерны — например, как погода, пробки и время влияют на заказ такси. Минус: жрут данные и ресурсы.

- Ансамблевые предикторы: Команда моделей (градиентный бустинг, XGBoost). Как "Мстители" — каждый герой слаб сам по себе, но вместе они тащат.

Пример: Netflix использует ансамбли, чтобы угадать, что ты посмотришь в пятницу вечером. А ты думал, это магия?

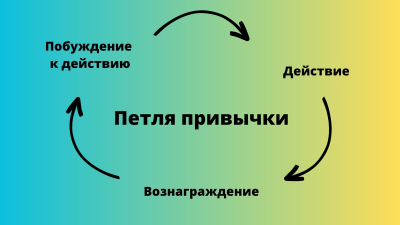

Как выбрать предиктор? Не промахнись!

Выбрать предиктор — это как подобрать шмотки: что-то модное, но не всегда удобно. Вот чек-лист:

- Тип данных: Числа? Линейная регрессия. Категории (цвет, размер)? Деревья.

- Объем данных: Мало — простые модели. Много — нейронки или леса.

- Задача: Число (цена)? Регрессия. Да/нет (спам)? Классификация.

- Метрики: Ошибка (MAE, RMSE) для чисел, точность (Accuracy) для классов. Чем меньше ошибка, тем ты круче.

Лайфхак: начни с простого, как с супа из пакета, а потом добавляй специи — тестируй сложные модели.

Где живут предикторы? Реальные кейсы

Предикторы — не только код в ноутбуке, они везде:

- Рекомендации: YouTube знает, что ты залипнешь на котиках, благодаря предикторам.

- Медицина: Модели предсказывают рак по снимкам лучше некоторых врачей.

- Финансы: Алгоритмы угадывают, упадет ли биткоин (но не верь им на 100%).

Круто? А теперь представь: предиктор в твоем телефоне знает, когда ты захочешь кофе!

Откуда взялись предикторы? Короткий экскурс

Предикторы родились не вчера. В 1800-х статистики вроде Фрэнсиса Гальтона считали корреляции вручную. Потом пришли компьютеры, и в 90-х Deep Blue уделал Каспарова в шахматах — предиктор предсказал ходы чемпиона! Сегодня ИИ вроде GPT — это мега-предиктор текста. Эволюция, братан!

Эксперимент: сравниваем предикторы

Давай замутим тест: предскажем цены на жилье тремя способами — линейная регрессия, случайный лес и нейронка. Вот код (сокращенный):

import numpy as np

import pandas as pd

from sklearn.linear_model import LinearRegression

from sklearn.ensemble import RandomForestRegressor

from sklearn.neural_network import MLPRegressor

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_absolute_error

import matplotlib.pyplot as plt

# Данные

np.random.seed(42)

data = {'площадь': np.random.uniform(50, 200, 100),

'цена': 10000 + 5000 * np.random.uniform(50, 200, 100) + np.random.normal(0, 10000, 100)}

df = pd.DataFrame(data)

X, y = df[['площадь']], df['цена']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Модели

models = {

'Линейная': LinearRegression(),

'Случайный лес': RandomForestRegressor(n_estimators=100, random_state=42),

'Нейронка': MLPRegressor(hidden_layer_sizes=(50,), max_iter=500, random_state=42)

}

# Сравнение

results = {}

for name, model in models.items():

model.fit(X_train, y_train)

y_pred = model.predict(X_test)

mae = mean_absolute_error(y_test, y_pred)

results[name] = mae

plt.scatter(X_test, y_pred, label=f'{name} (MAE: {mae:.0f})')

plt.scatter(X_test, y_test, color='black', label='Реальные цены')

plt.xlabel('Площадь (м²)')

plt.ylabel('Цена (руб)')

plt.title('Сравнение предикторов')

plt.legend()

plt.show()

print("Результаты:", results)Что видим? Линейная регрессия — простая, но MAE выше. Лес — точнее, нейронка — зависит от настройки. Запусти код и сравни сам: Google Colab.

Попробуй сам: мини-задача

Хочешь быть крутым? Предскажи, сколько лайков наберет твой пост. Возьми данные (время, длина текста), добавь в код выше и удиви друзей! Подсказка: начни с леса.

Интересные факты: предикторы, которые удивили мир

Вот что отжигают предикторы:

- Google Maps предсказывает пробки с точностью до минуты — магия GPS и истории.

- Deep Blue в 1997 обыграл Каспарова — предиктор ходов, а не просто железо.

- Метеорологи кидают 100 моделей в ансамбль, чтобы угадать дождь. Хаос побежден!

Заключение: стань мастером предикторов

Предикторы — это твой билет в будущее. Они угадывают погоду, фильмы, даже твое настроение (шутка... или нет?). Попробуй замурить свой проект — предскажи расходы или время на дорогу. Какой предиктор ты выберешь? Пиши в комменты, делай скриншоты своих графиков — устроим баттл предикторов!